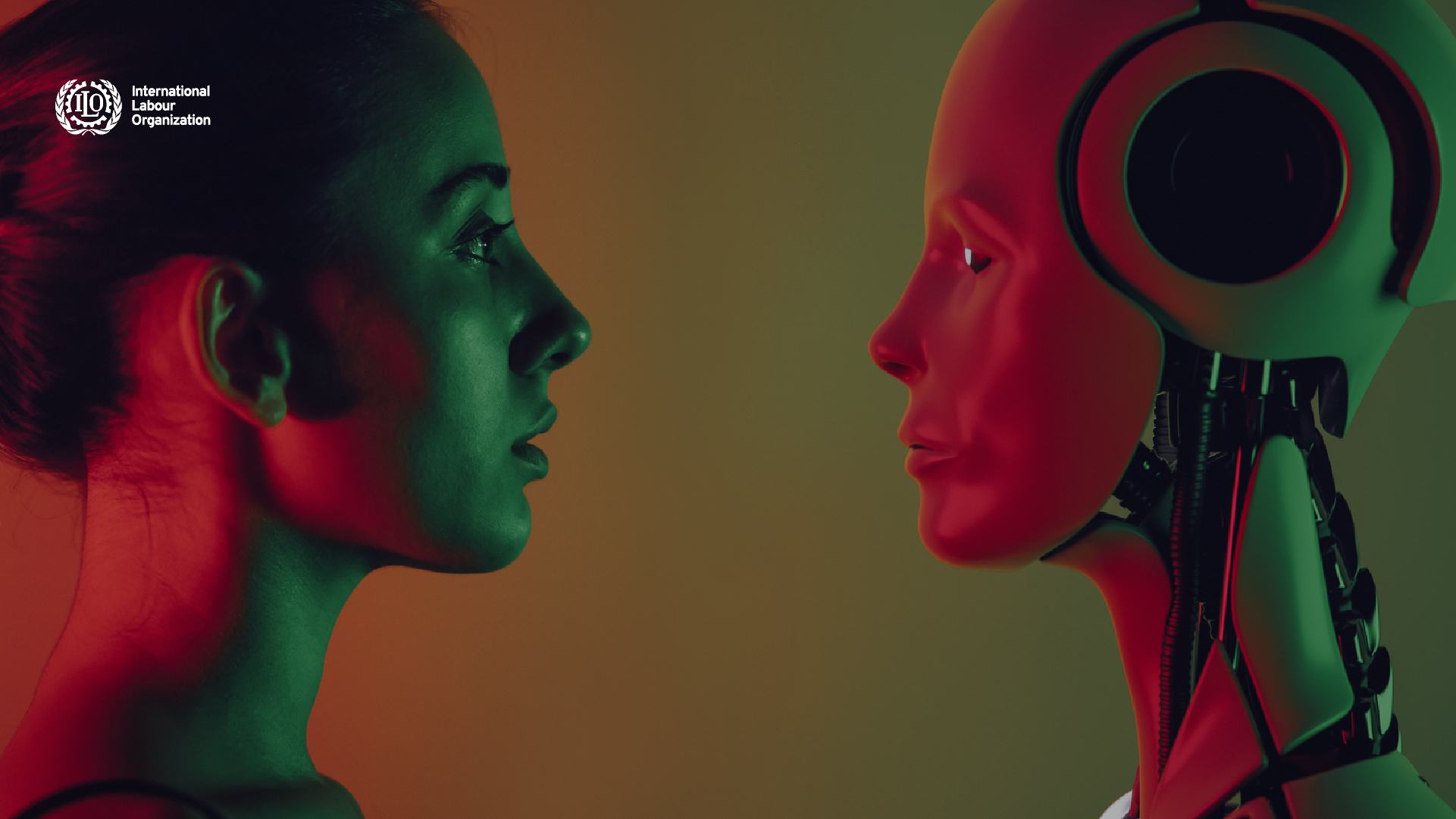

De AI-verordening is wereldwijd de eerste uitgebreide wet over kunstmatige intelligentie. In deze wet staan regels voor het verantwoord ontwikkelen en gebruiken van AI door bedrijven, overheden en andere organisaties. De verordening gaat gefaseerd in en zal op 2 augustus 2027 geheel van kracht zijn. De eerste eisen gelden vanaf februari 2025. Dan zijn sommige toepassingen van AI al verboden.

De Nederlandse Autoriteit Persoonsgegevens raadt ontwikkelaars en organisaties en bedrijven die gebruik maken van AI aan zich nu alvast voor te bereiden op de bepalingen van de nieuwe wet.

Risico’s inventariseren

Voor ontwikkelaars en gebruikers van AI is het van belang te inventariseren welke AI-systemen zij aanbieden of zelf gebruiken. Er zijn verschillende risicogroepen. Het kan gaan om AI-systemen die straks verboden zijn, systemen met een hoog risico, of systemen met een beperkt risico.

Verboden AI

Ontwikkelaars moeten deze systemen uit de handel nemen en organisaties die ze gebruiken moeten daarmee stoppen. De bepalingen over verboden AI zijn vanaf februari 2025 al van kracht. De kans is groot dat organisaties met deze systemen nu al de wet overtreden, bijvoorbeeld wetgeving op het gebied van gelijke behandeling, privacy, of arbeidswetgeving.

Denk aan systemen die worden gebruikt in of voor:

- Social scoring op basis van bepaald sociaal gedrag of persoonlijke kenmerken.

- Predictive policing om strafbare feiten bij mensen te beoordelen of te voorspellen.

- Het creëren of (via scraping) uitbreiden van databanken voor gezichtsherkenning.

- Biometrische identificatie op afstand voor rechtshandhaving (er zijn enkele uitzonderingen).

- Biometrische categorisering, waarbij mensen op basis van biometrische gegevens in bepaalde gevoelige categorieën worden ingedeeld.

Vanaf augustus 2025 moeten organisaties die verboden AI ontwikkelen of inzetten rekening houden met forse boetes. De Autoriteit Persoonsgegevens zegt de komende tijd meer duidelijkheid te geven over welke systemen wel en niet onder het verbod vallen.

AI met een hoog risico

Deze systemen moeten voldoen aan eisen zoals risicobeheer, de kwaliteit van de gebruikte data, technische documentatie en registratie, transparantie en menselijk toezicht. Er is ook een keurmerk verplicht voor deze systemen.

Denk aan systemen die worden gebruikt in of voor:

- Onderwijs of beroepsopleiding. Bijvoorbeeld het beoordelen van examens.

- Werkgelegenheid, personeelsbeheer en toegang tot zelfstandige arbeid. Zoals een AI-systeem dat automatisch cv's selecteert voor de volgende ronde in een wervingsprocedure.

- Essentiële particuliere en openbare diensten. Bijvoorbeeld software die bepaalt wanneer iemand wel of geen uitkering of lening krijgt.

- Rechtshandhaving. Zoals een AI-systeem dat wordt gebruikt voor de beoordeling van de betrouwbaarheid van bewijsmateriaal.

- Migratie, asiel en grenzen. Bijvoorbeeld geautomatiseerde behandeling van asielaanvragen.

- Rechtsbedeling en democratische processen. Zoals een AI-systeem dat ondersteunt bij rechterlijke uitspraken.

Gebruikers van AI-systemen kunnen al informeren bij de aanbieder of deze voorbereidingen treft om het AI-systeem te laten voldoen aan de eisen. Voor overheden of uitvoerders van publieke taken gelden soms aanvullende vereisten. Dat kan bijvoorbeeld een ‘grondrechteneffectbeoordeling’ zijn. Lukt het niet om aan deze eisen te voldoen, dan mogen ontwikkelaars deze systemen niet aanbieden en mogen organisaties ze niet gebruiken.

AI met een beperkt risico

Voor systemen die bedoeld zijn om met personen in contact te komen (zoals chatbots) of die inhoud genereren (zoals deepfakes), gelden transparantieverplichtingen. Bij aanbod of gebruik van deze systemen moeten mensen daarover worden geïnformeerd.

Ontwikkelaars moeten hun systemen zo ontwerpen dat dit kan, en organisaties die de systemen inzetten moeten mensen daadwerkelijk op de hoogte brengen. Gebruikers van AI-systemen doen er goed aan te informeren bij de aanbieder hoe het daarmee staat.

Kennisplicht vanaf februari 2025

Vanaf februari 2025 geldt ook de eis dat organisaties die AI-systemen inzetten, voldoende kennis in huis moeten hebben over AI. Het kennisniveau per medewerker moet aansluiten bij de context waarin de AI-systemen worden gebruikt en hoe de systemen personen kunnen raken.

De AI-kennisplicht betekent dat een organisatie moet weten dat een AI-systeem vooroordelen kan bevatten of essentiële informatie kan negeren. Een baliemedewerker bij een gemeente bijvoorbeeld, die AI-systemen gebruikt om de identiteit van burgers te verifiëren, moet beseffen dat deze systemen vaak niet even goed werken voor iedereen. En dat diegene de uitkomsten van dit soort AI-systemen dus niet blindelings kan volgen.

De Autoriteit Persoonsgegevens heeft een stappenplan ontwikkeld voor ontwikkelaars en gebruikers over de acties die zij moeten nemen om aan de AI-verordening te voldoen.

Dit artikel verscheen in iets ander vorm op ORnet